Алгоритм назвали Норманом в честь героя знаменитого триллера Альфреда Хичкока «Психо» и его сиквелов. По сюжету, Норман Бейтс — был психопатом с раздвоением личности.

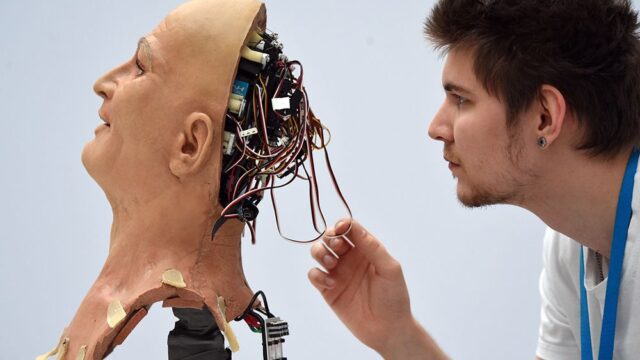

Нормана разработали ученые из Массачусетского технологического института. Исследователи хотели проверить, что хранится в «темных уголках» ИИ и как это повлияет на его мировоззрение.

Норману показывали сцены убийств, фотографии людей, которые умирали в жутких обстоятельствах. Затем ИИ, который может интерпретировать изображения и описывать то, что он видит в текстовой форме, показали рисунки из теста Роршаха и спросили, что он увидел.

Норман видел в каждом изображении мертвые тела, кровь и разрушения, в то время как «обычному» ИИ представлялись «стаи птиц» или «вазы с цветами».

Эти выводы демонстрируют, что данные для обучения ИИ имеют большее значение, чем сам алгоритм. «Это придает большее значение данным, которые мы используем для ИИ, потому что это отражается на его дальнейшем поведении», — сказал профессор Ияд Рахван, который работает вместе с двумя другими разработчиками Нормана.

Ученые пояснили, что Норман «неравнодушен» к смерти и разрушению, потому что они его этому научили. Это значит, что ИИ может быть предвзятым в определенных ситуациях, если его так обучить. Например, компьютерная система для судов в США, которую создал искусственный интеллект, была несправедлива по отношению к чернокожим заключенным.

Иногда ИИ «учится» от пользователей. Так, чат-бот «Тай» от Microsoft, который использовали в твиттере в 2016 году, быстро научился расизму и троллингу. А еще он одобрял геноцид и признавался в симпатиях к Гитлеру. После таких случаев чат-бот вернули на доработку.

Все эти случаи говорят о том, что вскоре ученым придется изучать «психологию ИИ», отмечает Би-би-си.