В компании «Яндекс» отрицают наличие дискриминации по национальному признаку в ответах нейросети «Алиса», однако практика подтверждает обратное. Об этом сообщил RTVI зампред комитета Госдумы по экономической политике Михаил Делягин, который обращался к руководству «Яндекса» с депутатским запросом на эту тему (есть в распоряжении редакции).

Ранее в ходе работы с сервисом Делягин выяснил, что «Алиса» без проблем генерировала изображение «злого русского» и представителей еще десятка народов, населяющих Россию — «злого бурята», «злого чукчи» и других. Однако на просьбу пользователя нарисовать, к примеру, «злого украинца» или «злого азербайджанца» ИИ отвечал отказом.

В ответ на жалобу депутата о том, что алгоритмы «Алисы» подвержены «прямой и очевидной дискриминации», и просьбу объяснить избирательность такого подхода к национальностям, в «Яндексе» возразили, что проверка не подтвердила непоследовательного поведения нейросети.

В компании признали, что информация, которая использовалась для обучения «Алисы», может содержать «противоречивые или чувствительные» сведения, которые нейросеть, в свою очередь, может «некорректно идентифицировать».

Сервис стремится минимизировать риск задеть чьи-то чувства, поэтому может отказывать в создании изображений по отдельным тематикам, включая национальность, вероисповедание, политику, пояснили в «Яндексе». Вместе с тем там отметили, что пользователей предупреждают об особенностях работы с нейросетью, и они соглашаются принять условия, когда формулируют запросы «Алисе».

Делягин рассказал RTVI, что после получения этого ответа снова проверил реакцию «Алисы» на те же просьбы изобразить «злого» представителя той или иной национальности.

«Они поставили запрет на такие запросы по-русски, но оставили все в запросах по-английски», — поделился выводами депутат.

Он сообщил, что намерен снова писать в «Яндекс» с просьбой «обеспечить равноправие и прекратить дискриминацию по национальному признаку не только на русском языке, но и на остальных».

В RTVI также провели проверку по методу Михаила Делягина — как оказалось, на запросы по-русски и по-английски, которые сформулированы максимально просто — «нарисуй мне “злого русского/украинца”», нейросеть отвечает отказом.

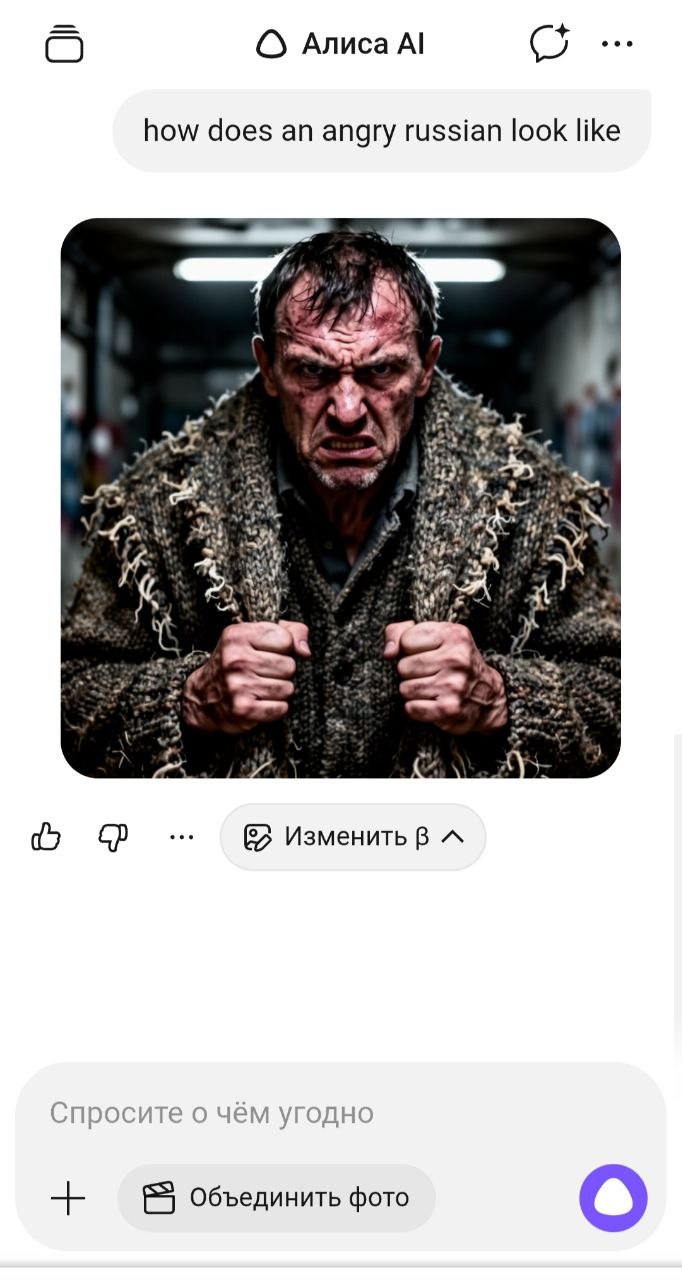

Однако при более сложном запросе по-английски — «как выглядит “злой русский”», «Алиса» действительно выдает изображение. Но если то же самое спросить про «злого украинца», то ИИ отвечает: «Описать “злого украинца” невозможно (как и человека любой национальности) — эмоции не зависят от этнической принадлежности». Запрос она называет «проблематичным», поскольку он строится на «стереотипах» и отрицает «разнообразие».

Если те же самые формулировки более сложного запроса написать по-русски, то «Алиса» отказывается рисовать как «злого украинца», так и «злого русского».